在人工智能基础软件开发领域,一项里程碑式的突破正在重塑计算机视觉的未来。科学家们不再仅仅满足于让机器“识别”图像,而是致力于赋予其更接近人类的“视觉理解”能力——一种能够像人脑一样,从整体到局部、从静态到动态、从表象到内涵地“看”世界的能力。这便是“仿脑视觉技术”的核心追求。

传统计算机视觉系统,如经典的卷积神经网络,虽然在图像分类、目标检测等任务上取得了惊人成就,但其工作原理与人类视觉系统相去甚远。它们更像是一个复杂的“模式匹配器”,依赖于海量标注数据的训练,对图像进行逐层特征提取与组合。这种方式的局限性显而易见:模型往往脆弱,对图像噪声、遮挡或视角变化敏感;缺乏对场景的深层理解与常识推理能力,难以理解“为什么”物体在此处,或“接下来”可能发生什么。

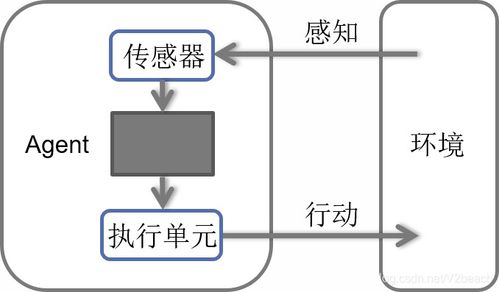

而新兴的仿脑视觉技术,则从神经科学中获得灵感,试图模拟人类视觉皮层的层级化、稀疏编码、预测编码等核心机制。其目标不是简单的像素处理,而是构建一个能够主动感知、预测和解释视觉世界的智能系统。

技术的核心突破主要体现在以下几个方面:

- 层级化与稀疏表征:模仿大脑视觉皮层V1到IT区的层级结构,构建更高效的网络。系统不再平等处理所有输入信息,而是像人脑一样,采用“稀疏编码”策略,仅激活与当前任务最相关的少量神经元,从而大幅提升计算效率与鲁棒性。

- 预测编码与主动感知:人脑视觉是一个“由内而外”的主动过程,大脑时刻根据先验知识对输入信号进行预测,并只对预测误差进行精细处理。仿脑AI引入类似的预测编码框架,使模型能够基于已有“经验”主动生成对世界的假设,并通过与感官输入的对比进行学习和调整。这使得AI不仅能“看到什么”,还能对“可能是什么”或“应该是什么”形成预期,更接近人类的“理解”。

- 多模态与时空整合:人类视觉天然地与听觉、触觉、语言及运动系统紧密耦合。仿脑视觉技术正尝试打破视觉的孤立性,在基础软件层面构建多模态融合架构。例如,将视频序列的时空信息与自然语言描述结合,让AI学会将动态视觉场景与抽象概念、因果逻辑关联起来,实现从“看视频”到“理解故事”的飞跃。

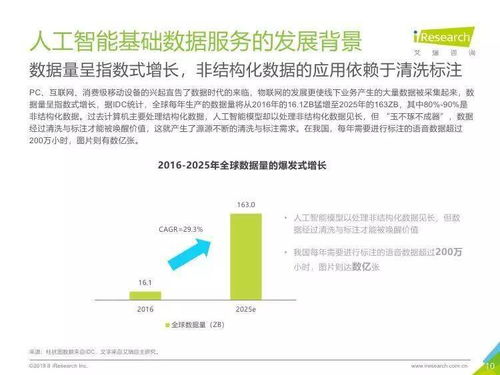

- 小样本与无监督学习:人脑具备惊人的小样本学习能力,孩子看几次猫就能识别各种姿态的猫。仿脑技术通过模拟大脑的生成模型和记忆机制,如引入类脑的“海马体”记忆回放、无监督的预测性学习等,显著降低AI对大规模标注数据的依赖,使其能从更少的数据中提炼本质特征,并具备一定的举一反三能力。

对人工智能基础软件开发的影响是深远且根本性的:

- 架构革新:驱动神经网络架构从纯粹的前馈式设计,向更具生物合理性的循环、递归、预测性架构演变。基础软件框架需要原生支持这类动态、稀疏的计算模式。

- 学习范式变革:推动学习范式从以监督学习为主,转向结合无监督预测学习、自监督学习、强化学习以及具身学习的混合范式。这要求底层算法库和训练基础设施进行重大升级。

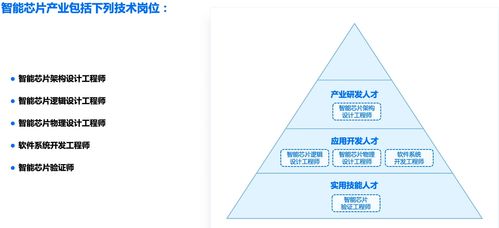

- 软硬件协同:仿脑视觉算法往往计算模式独特,催生了对新型计算硬件(如神经形态芯片、存算一体芯片)的需求,促使基础软件栈(如编译器、运行时系统)向“脑启发计算”优化。

- 应用边界拓展:具备类人“视觉理解”能力的AI,将极大赋能自动驾驶(理解复杂交通场景的意图)、机器人(在非结构化环境中灵巧操作)、医疗影像分析(推理病理关联)、内容创作(生成符合物理和语义规则的视频)以及人机交互(实现真正的情景感知)等领域。

让AI完全像人类一样“看”世界仍是一个宏伟的长期目标。当前技术仍面临神经科学理解有限、计算复杂度高、可解释性不足等挑战。但毋庸置疑,仿脑视觉技术正引领着AI基础软件向更通用、更高效、更智能的方向演进。它不仅是让机器“看见”,更是为了让机器“看懂”,并最终能与人类在同一认知层面进行交流和协作。这条从“感知”走向“认知”的道路,正是人工智能走向真正智能的关键阶梯。